管理 AI Enterprise

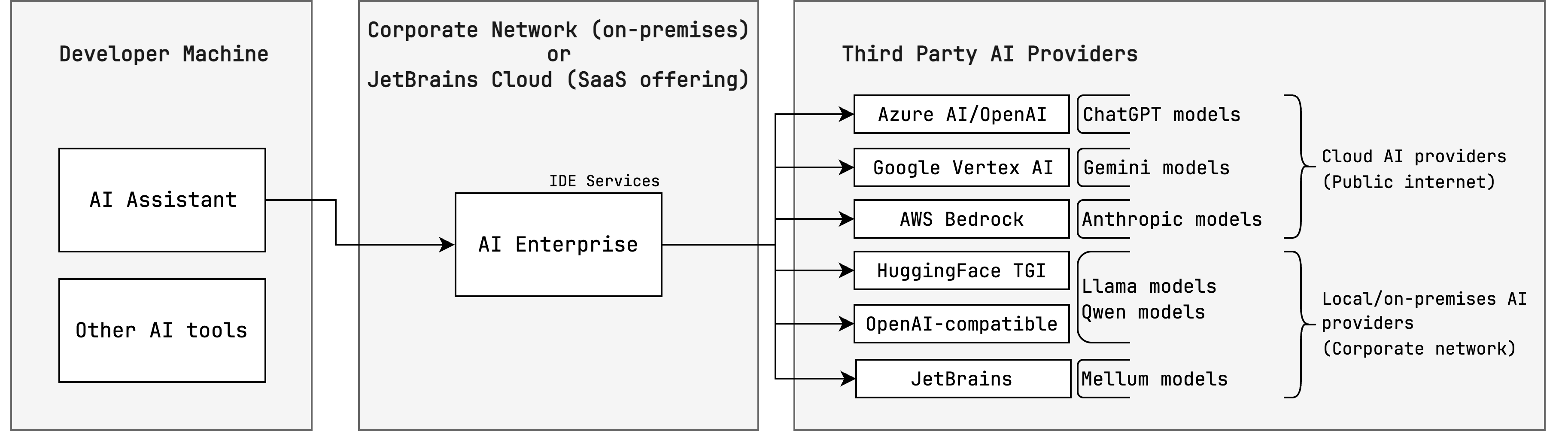

AI Enterprise 允许您在整个组织内使用不同的 AI 服务提供商 — JetBrains AI 或自定义方案,如:

您可以启用 所有选项 ,然后为特定用户配置文件 选择首选提供商。

在您的组织中启用 AI Enterprise

在 Web UI 中,打开 Configuration (配置) 页面并转到 License & Activation (许可证与激活) 标签页。

向下滚动到 AI Enterprise 部分并点击 Enable (启用):

在 Enable AI Enterprise (启用 AI Enterprise) 对话框中,选择一个 AI 提供商。 有关具体配置说明,请参阅以下步骤:

如果您想为特定配置文件使用不同的 AI 提供商,您可以随时 添加并启用 其他提供商。

为 AI Enterprise 设置使用限制。

点击 Apply (应用)。

在您的组织中启用 AI Enterprise 后,您需要 为相关配置文件选择并启用 AI 提供商。 在此之前,开发者无法访问 AI 功能和 AI 助手插件。

请确保开发者 通过 Toolbox 应用程序 连接到 IDE 服务服务器 ,否则将无法使用提供的 AI 功能。

使用 JetBrains AI 服务

默认情况下,JetBrains 产品中的 AI 功能由 JetBrains AI 服务驱动。 该服务会以透明方式将您连接到不同的 大型语言模型 (LLMs),并在 JetBrains 产品中启用特定的 AI 驱动功能。 此服务由 OpenAI 和 Google 作为主要第三方提供商驱动,并包含若干 JetBrains 专有模型。 JetBrains AI 以云端方案部署在 JetBrains 侧,您无需额外配置。

添加 AI 提供商:JetBrains AI

使用您自己的 AI 提供商

AI Enterprise 可搭配 Google Vertex AI、Amazon Bedrock 及由 OpenAI 提供的预设模型使用。

OpenAI 平台

开始前,请确保设置好 OpenAI 平台账户并获得用于认证的 API 密钥。 有关详细信息,请参阅 OpenAI 文档。

添加 AI 提供商:OpenAI 平台

导航到 。

向下滚动到 AI Enterprise 部分并点击 Settings (设置)。

打开 选项卡。

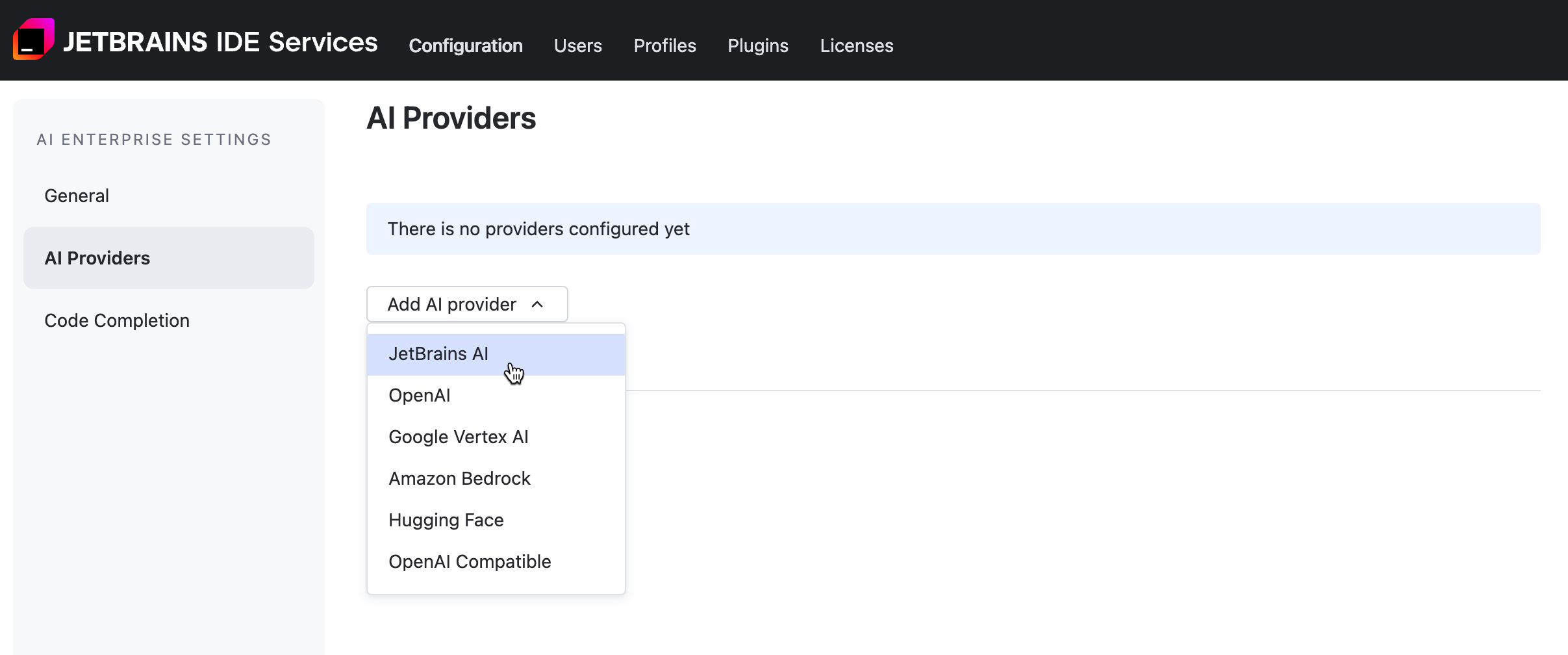

点击 Add provider (添加提供商) ,并在菜单中选择 。

在 OpenAI 对话框中,指定以下详细信息:

从 Preset (预设) 列表中选择 OpenAI Platform (OpenAI 平台)。

提供用于与 OpenAI 服务通信的端点。 例如,

https://api.openai.com/v1。提供您的 API 密钥以验证 OpenAI API。 更多信息可参阅 OpenAI 文档。

(可选)AI Enterprise 在 JetBrains 产品中通过 GPT-3.5-Turbo、 GPT-4 和 GPT-4o mini 模型提供 AI 驱动的功能。 不过,如果您的账号下有 GPT-4o 模型,建议点击 Add model (添加模型) 将其添加到列表中。

点击 。

Azure OpenAI

在启用 Azure OpenAI 作为您的提供商前,请完成以下步骤:

部署所需模型: GPT-3.5-Turbo、 GPT-4。

获取端点和 API 密钥。 导航到

获取您的模型部署名称。 您可以在 找到它们

完成上述准备步骤后,您可以在 IDE Services 中启用 Azure OpenAI。

添加 AI 提供商:Azure OpenAI

导航到 。

向下滚动到 AI Enterprise 部分并点击 Settings (设置)。

打开 选项卡。

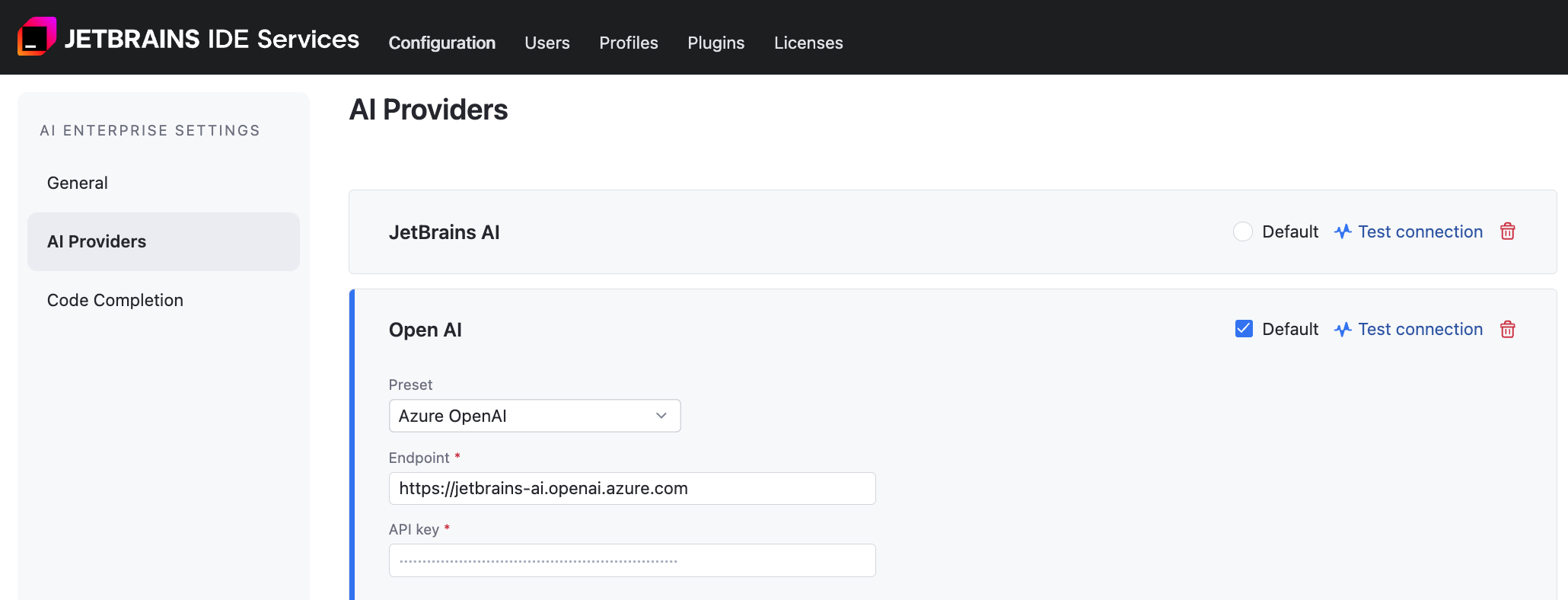

在 OpenAI 对话框中,指定以下详细信息:

从 Preset (预设) 列表中选择 Azure OpenAI。

提供用于与 Azure OpenAI 服务通信的端点。 例如,

https://YOUR_RESOURCE_NAME.openai.azure.com。提供您的 API 密钥以验证 Azure OpenAI API。

指定模型的部署名称。 点击每个模型旁的齿轮图标输入其名称。

(可选)AI Enterprise 在 JetBrains 产品中通过 GPT-3.5-Turbo、 GPT-4 和 GPT-4o mini 模型提供 AI 驱动的功能。 不过,如果您的账号下有 GPT-4o 模型,建议点击 Add model (添加模型) 将其添加到列表中。

点击 。

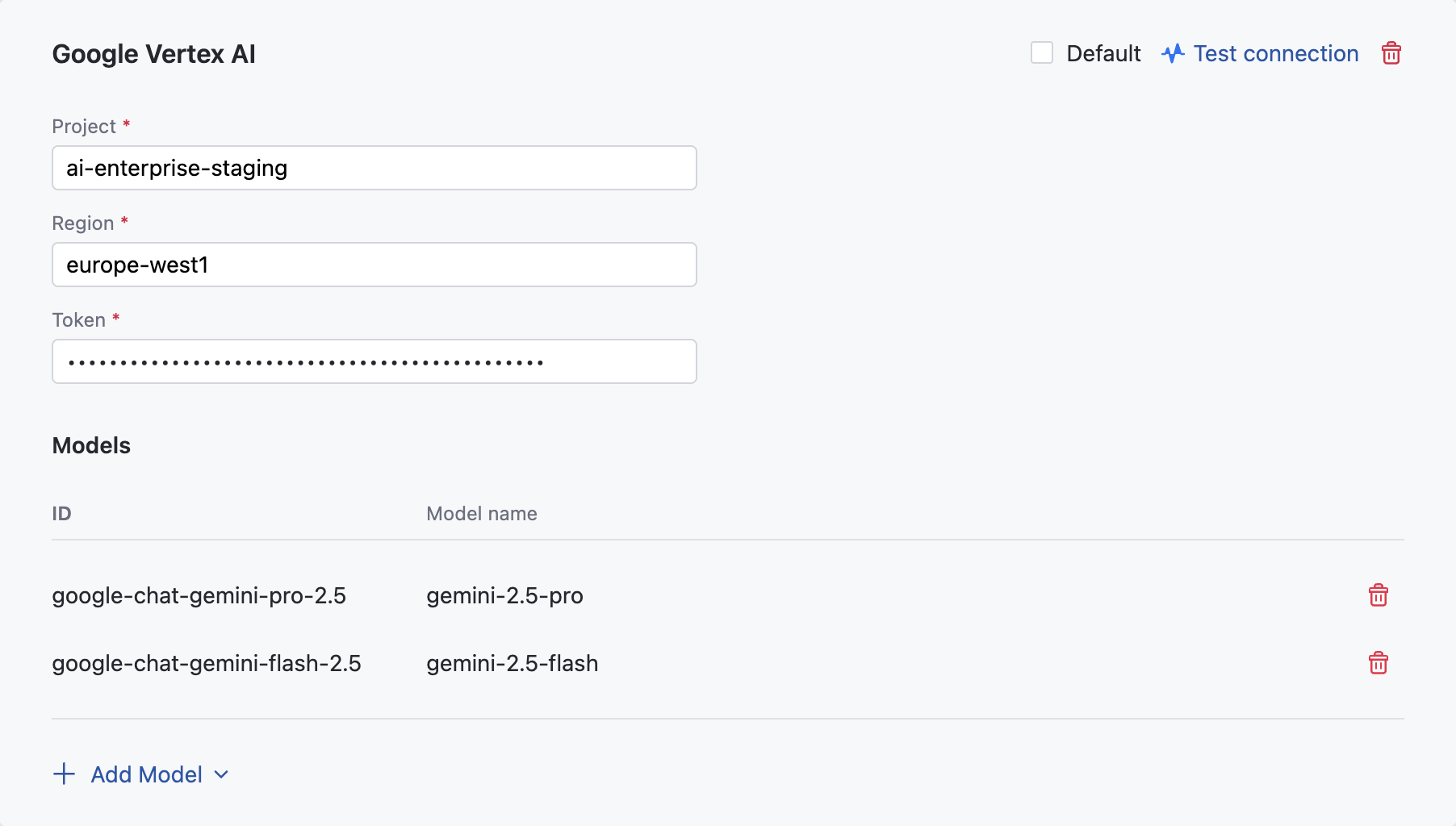

Google Vertex AI

在启用 Google Vertex AI 作为你的提供商前,请完成以下步骤:

完成上述准备步骤后,您可以在 IDE Services 中启用 Google Vertex AI。

添加 AI 提供商:Google Vertex AI

导航到 。

向下滚动到 AI Enterprise 部分并点击 Settings (设置)。

打开 选项卡。

在 Google Vertex AI 对话框中,指定以下详细信息:

在 Project (项目) 字段中,指定 Google Cloud 项目的名称。

在 Region (区域) 字段中,指定 Google Vertex AI 区域。

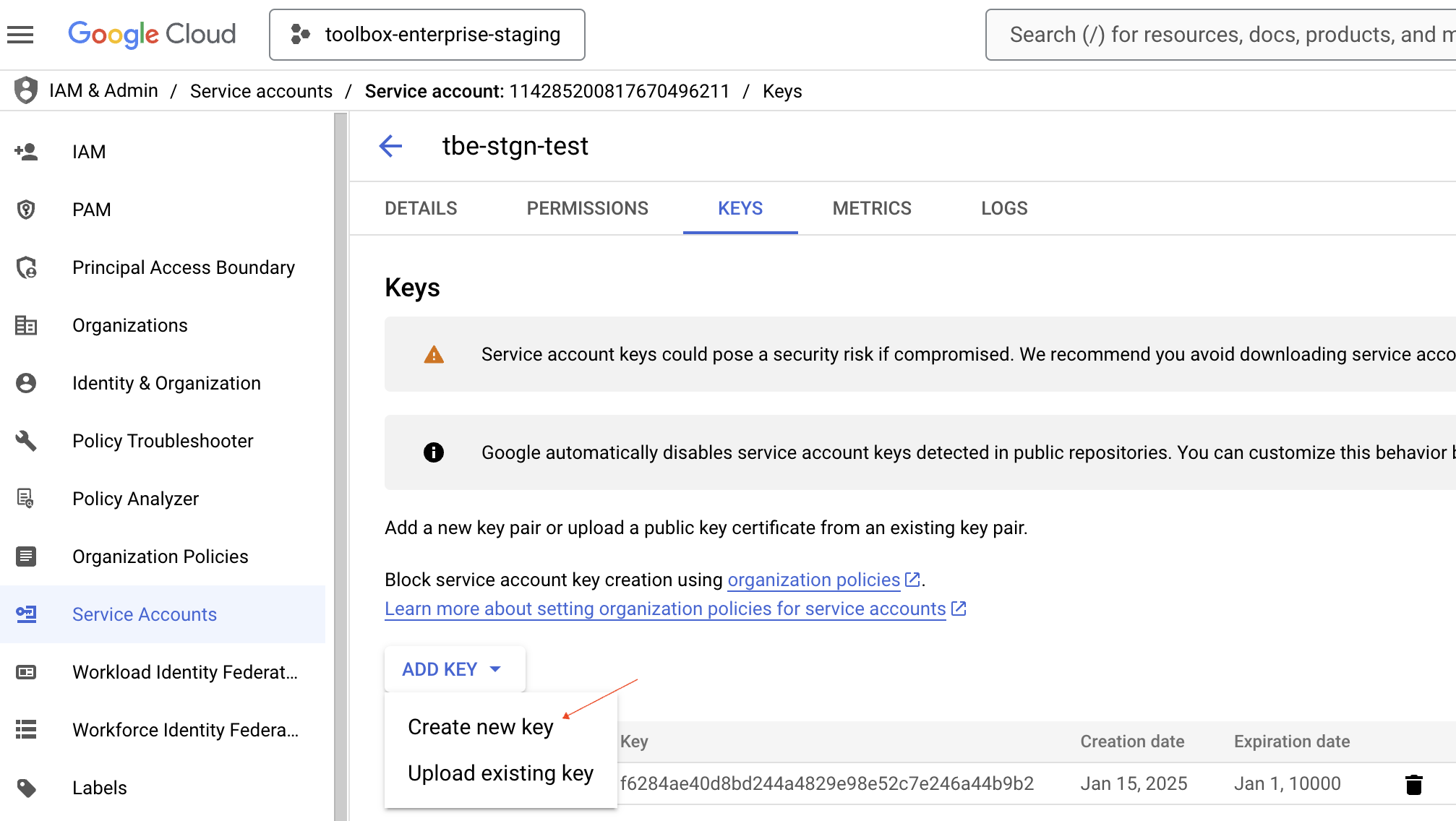

在 Token (令牌) 字段中,指定之前 创建的 JSON 格式服务账户密钥。

点击 。

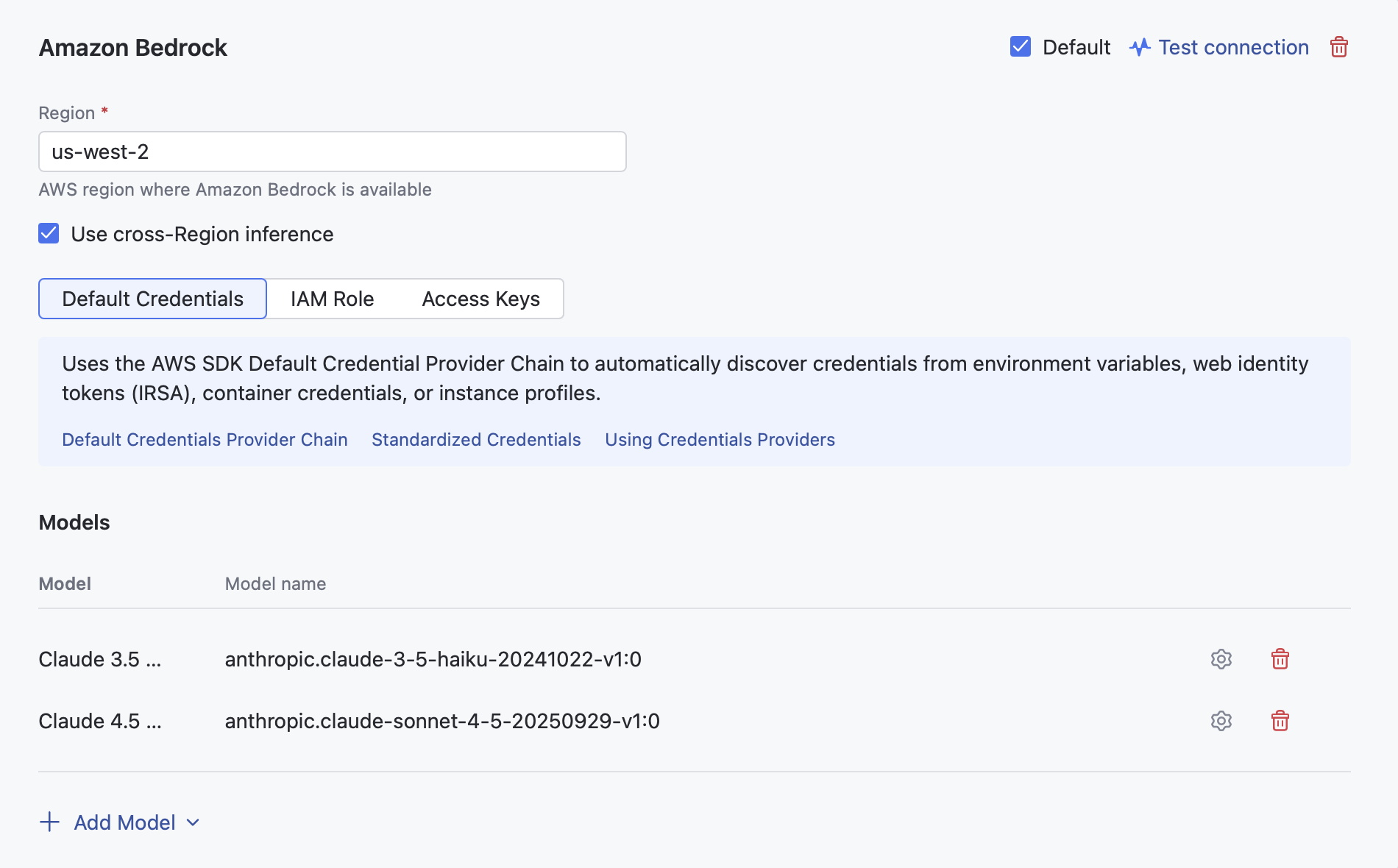

Amazon Bedrock

AI Enterprise 支持与 Amazon Bedrock 集成,这是一项全托管服务,可访问多种高性能基础模型。 当前版本下,AI Enterprise 在 AI 助手中支持以下 LLMs: Claude 3.0 Haiku、 Claude 3.5 Haiku、 Claude 3.5 Sonnet V2、 Claude 3.7 Sonnet、 Claude 4 Sonnet、 Claude 4.5 Haiku、 Claude 4.5 Sonnet。

在 IDE Services 中添加 Amazon Bedrock 作为 AI 提供商之前,您需要设置身份验证并访问支持的模型。

第 1 步。 在 AWS 端配置身份验证

您可以选择 IDE Services 支持的以下身份验证选项之一:

访问密钥

请按照 入门指南操作以:

创建 AWS 账户(如果您还没有的话)。

为 Amazon Bedrock 创建具有所需权限的 AWS 身份与访问管理(IAM)角色。

申请您要使用的基础模型(FM)的访问权限。

访问 AWS IAM 身份中心,找到您的用户,并查看 Permissions policies (权限策略) 部分。

除了默认权限策略

AmazonBedrockReadOnly外,为 Bedrock 服务添加新的内联策略。将新的内联策略配置为对 InvokeModel 和 InvokeModelWithResponseStream 操作具有 Read (读取) 访问级别。

为您的用户生成 访问密钥。

在创建访问密钥时,指定 Third-party service (第三方服务) 作为使用场景。

在 IDE Services中配置 Amazon Bedrock时,您需要提供访问密钥 ID 和密钥。 请务必保存这些值。

IAM 角色

以下是为 Amazon Bedrock 设置 AWS IAM 角色的方法:

在您的 AWS 控制台中导航到 IAM 服务。

创建权限策略。

转到 。 选择 JSON 选项卡,粘贴以下权限策略并点击 Next (下一个)。 为其命名(例如 "JetBrains-Bedrock-Policy"),并创建策略。

权限策略:

{ "Version" : "2012-10-17", "Statement" : [ { "Effect" : "Allow", "Action" : [ "bedrock:InvokeModel", "bedrock:InvokeModelWithResponseStream", "bedrock:ListFoundationModels", "bedrock:GetFoundationModel" ], "Resource" : "*" } ] }创建 IAM 角色

导航到 。

配置信任策略

选择 Custom trust policy (自定义信任策略) 并粘贴以下信任策略 JSON。 点击 Next (下一步)

信任策略:

{ "Version" : "2012-10-17", "Statement" : [ { "Effect" : "Allow", "Principal" : { "AWS" : "arn:aws:iam::205930650357:role/aws-env-iam-testing-role" }, "Action" : "sts:AssumeRole", "Condition" : { "StringEquals" : { "sts:ExternalId" : "B8983A86714F2468CF7FD95329FF9D61" } } } ] }附加权限

查找您在 第 2 步中创建的策略,选中它并点击 Next (下一条)。

命名并创建角色

为您的角色起一个描述性名称(例如 JetBrains-Bedrock-Access ),可选地添加标签,然后点击 Create role (创建角色)。

复制角色 ARN

创建后,点击角色名称查看详细信息。 复制角色 ARN,并粘贴到 IDE Services 的 AI 提供商配置表单中的 Role ARN 字段。

默认凭据

默认凭证是一种身份验证方法,它依赖于 AWS SDK 默认凭证提供链 ,可自动查找并加载来自受支持来源的 AWS 凭证。 这使包括 JetBrains IDE Services 集成 Amazon Bedrock 在内的应用程序无需手动提供静态凭据即可进行 AWS 服务身份验证。

凭证提供链按以下顺序查找凭证:

Web 身份令牌(OIDC) — 例如,Kubernetes ServiceAccount 令牌,用于通过 STS

AssumeRoleWithWebIdentity假定 IAM 角色。 更多详细信息。环境变量 —

AWS_ACCESS_KEY_ID、AWS_SECRET_ACCESS_KEY,以及可选的AWS_SESSION_TOKEN。 更多详细信息。容器凭证 — 由容器引擎(ECS/EKS)为分配有 IAM 角色的任务或 Pod 提供的凭证。 更多详细信息。

实例配置文件 / EC2 元数据服务 — 通过 EC2 实例元数据服务为附加到实例的 IAM 角色获取的凭证。 更多详细信息。

使用此提供链可以让 IDE Services 透明地从当前环境获取 AWS 凭证,符合 AWS 关于凭证管理和安全性的最佳实践。

设置默认凭证身份验证。 若要为 IDE Services AI Enterprise 上的 Amazon Bedrock 启用默认凭证身份验证方法,管理员必须配置 AWS 凭证来源。 支持以下两种选项。

选项 1:IRSA(推荐用于 EKS)

当 IDE Services 运行在 Amazon Elastic Kubernetes Service (EKS) 上时,推荐的方法是结合使用 Kubernetes ServiceAccount 和 IAM Roles for Service Accounts (IRSA) 进行安全的凭证管理。 AWS 文档

为您的 EKS 集群创建 OIDC 提供商(一次性设置):

eksctl utils associate-iam-oidc-provider --cluster <cluster‑name> --approve此步骤将关联集群的 OIDC 提供商。 AWS 指南:创建 IAM OIDC 提供商

为 ServiceAccount 创建具有允许

sts:AssumeRoleWithWebIdentity的信任策略的 IAM 角色。使用 IAM 角色 ARN 注解 Kubernetes ServiceAccount:

metadata: name: <service-account-name> namespace: <namespace> annotations: eks.amazonaws.com/role-arn: arn:aws:iam::<ACCOUNT_ID>:role/<ROLE_NAME>在 Helm 值文件中配置 IDE Services:

useS3AutoConfiguration: true featureFlags: bedrock-iam-role-auth: on bedrock-default-credentials: on

选项 2:环境变量(非生产/测试)

如果您的环境不支持 IRSA,您可以通过环境变量提供凭证。 此方法的安全性较低,仅建议用于开发或测试环境。

在 IAM 中创建具有访问 Amazon Bedrock 和 S3 权限的 AWS 访问密钥。

生成

AWS_ACCESS_KEY_ID、AWS_SECRET_ACCESS_KEY以及可选的AWS_SESSION_TOKEN。创建 Kubernetes Secret 用于存储密钥:

kubectl create secret generic aws-credentials \ --from-literal=AWS_ACCESS_KEY_ID=<your_access_key_id> \ --from-literal=AWS_SECRET_ACCESS_KEY=<your_secret_access_key>通过 Helm 或清单文件将环境变量注入 IDE Services 部署,从而向容器环境暴露密钥。

配置 IDE Services:

useS3AutoConfiguration: true featureFlags: bedrock-default-credentials: on

重要提示:虽然该方法适用于测试,但不具备 IRSA 的凭证轮换、最小权限控制或审计好处。 谨慎使用。

第 2 步。 在 AWS 端配置对模型的访问

请按照 AWS 说明申请以下支持的模型访问权限:

Claude 3.0 Haiku

Claude 3.5 Haiku

Claude 3.5 Sonnet V2

Claude 3.7 Sonnet

Claude 4 Sonnet

Claude 4.5 Haiku

Claude 4.5 Sonnet

第 3 步。 添加 AI 提供商:Amazon Bedrock

导航到 。

向下滚动到 AI Enterprise 部分并点击 Settings (设置)。

打开 选项卡。

点击 Add AI Provider (添加 AI 提供商) 并选择 Amazon Bedrock。

Amazon Bedrock 配置对话框将出现。

在 Region (区域) 字段中,指定支持 Amazon Bedrock 的 AWS 区域。

Use cross-Region inference (跨区域推理)。 此选项会自动选择所在地域内最适合的 AWS 区域来处理用户请求。 这会通过优化资源利用率并确保高模型可用性来提升体验。 (Claude 3.7 Sonnet 模型必需)

选择您在 AWS 端 已设置的身份验证选项:

Default Credential (默认凭据) - 如果已在 AWS 端配置,无需额外输入。

IAM Role (IAM 角色) - 输入您在 AWS 端创建的 角色 ARN。

点击 Add Model (添加模型) ,并从列表中选择要使用的模型。

在配置对话框中,指定模型名称,点击 。

保存您的设置。

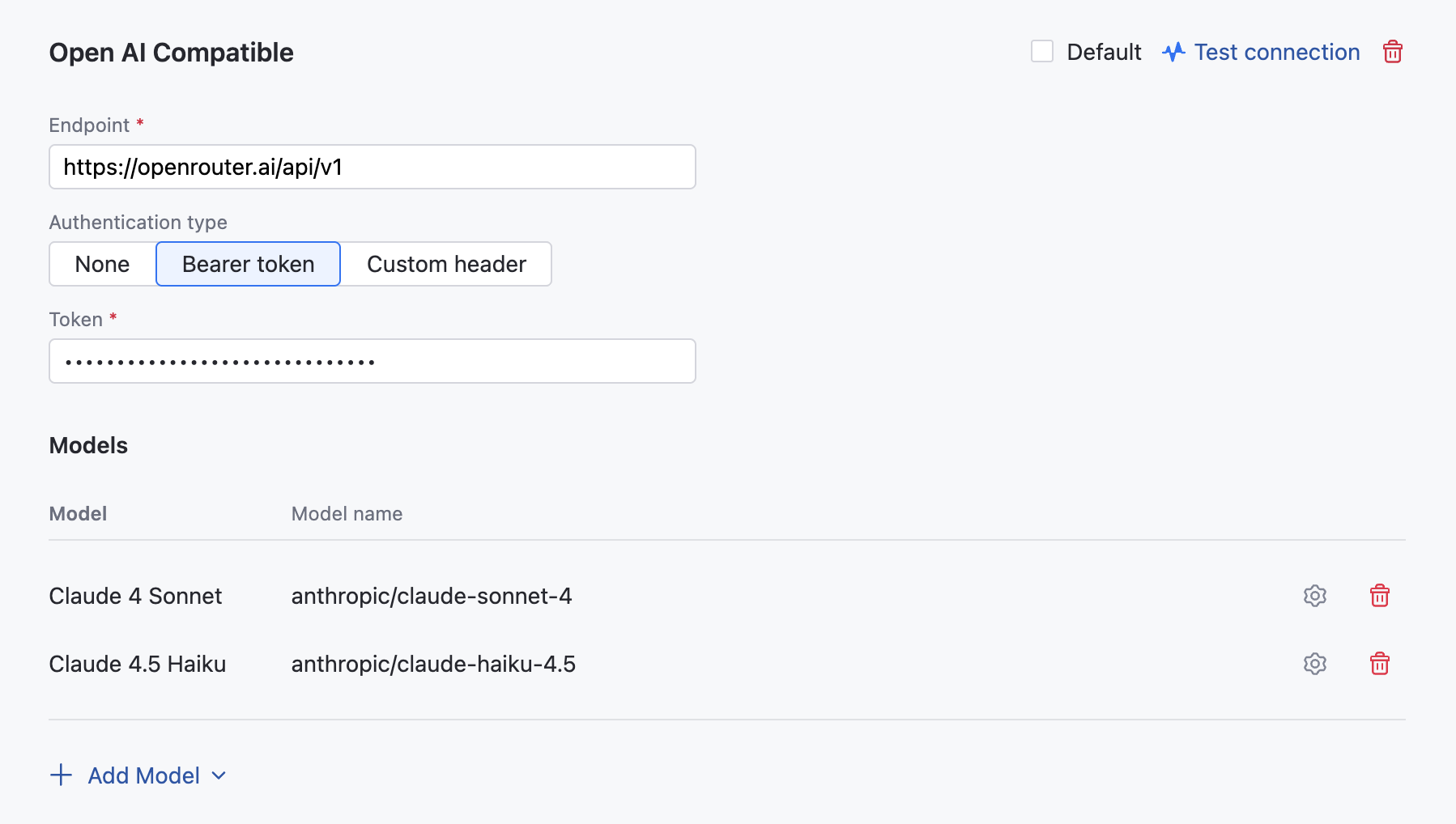

OpenAI 兼容

AI Enterprise 支持与 OpenRouter、LM Studio 等 AI 路由器集成,让您能够访问来自各类预批准提供商的大量模型。

此设置使您可以使用如 Claude、 GPT等知名高性能模型,同时还可使用其他自定义模型。 例如,您可以选择自定义模型如 Grok和 DeepSeek在 AI 助手聊天中使用。

您可以通过连接本地部署的兼容 OpenAI 的服务器(如 llama.cpp、 vLLM、 LMStudio )在隔离环境下运行 AI Enterprise。

添加 AI 提供商:OpenAI 兼容

导航到 。

向下滚动到 AI Enterprise 部分并点击 Settings (设置)。

打开 选项卡。

在 OpenAI Compatible (兼容 OpenAI) 对话框中,指定以下详细信息:

指定用于与您的 AI 路由器服务通信的终端节点。 例如

https://openrouter.ai/api/v1提供您的 Bearer 令牌以与 AI 路由器服务进行身份验证。 如果您的服务需要自定义 header 进行身份验证,请在对应字段中获取并填写 header 名称和值。

点击 Add Model (添加模型) ,并从列表中选择要使用的模型。

如果添加的模型不支持 Tools calling (工具调用)、 Functions calling (函数调用) 或 Multimedia messages (多媒体消息) ,请取消选择这些选项。

如果添加 custom model (自定义模型):

在 Configure ... model (配置 ... 模型) 对话框中,选择与您初始选择匹配的模型名称。

设置 Max input/output tokens (最大输入/输出 Token 数)。 自定义模型需指定输入和输出上下文长度——即模型每次请求可处理的最大 token 数。 如 AI 助手和 Junie 等工具会依据这些值决定作为上下文的数据量。 请根据提供方或模型文档定义的限制进行设置。 输入限制尤其重要,因为它决定工具如何选择和裁剪用于处理的文件或历史记录。

请注意,不保证自定义模型的性能。

点击 Save (保存)。

如需配置更多模型,请重复上述步骤。

点击 。

Junie 编码智能体

JetBrains Junie 是一款 AI 驱动的编码代理,可直接在支持的 JetBrains IntelliJ IDEA 系列 IDE 内使用,并以插件形式提供。

与传统代码助手不同,Junie 能自主执行生成代码、运行测试、修复错误并适应项目规范等任务——同时让开发者始终掌控全局。 它能理解项目上下文,支持协作流程,旨在提升生产效率和代码质量。

Junie 可由 JetBrains AI 服务提供的大型语言模型(LLM)驱动,或者可选地使用 OpenAI 和 Amazon Bedrock 提供的特定模型集。

启用 Junie

如已 启用 JetBrains AI 服务 ,则无需对 AI Enterprise 设置进行其他配置。 要让开发者可用 Junie, 请前往选定配置文件中启用。

如果未启用 JetBrains AI 服务,您应选择 Azure OpenAI、Open AI 平台或 Amazon Bedrock,并按以下方式配置:

在控制台主页找到 AI Enterprise 小部件并点击 Settings (设置)。

启用并配置以下任意一款 AI 提供商:

将以下模型添加到配置中:

GPT-4o

GPT-4o-Mini 或 GPT-4.1-Mini

GPT-4.1

GPT-5 或 GPT-5.2

将以下模型添加到配置中:

GPT-4o

GPT-4o-Mini 或 GPT-4.1-Mini

GPT-4.1

GPT-5 或 GPT-5.2

将以下模型添加到配置中:

Claude 4.5 Sonnet

Claude 4.5 Haiku 或 Claude 3.5 Haiku 或 Claude 3.0 Haiku

选择 Use cross-Region inference (跨区域推理)。

要使 Junie 可供开发者使用, 请继续在选定的配置文件中启用它。

AI Enterprise 设置

启用其他 AI 提供商

为您的组织启用 AI Enterprise 时,只能选择一个 AI 提供商。 要启用其他提供商:

导航到 。

向下滚动到 AI Enterprise 部分,并点击 Settings (设置)。

打开 选项卡。

点击 Add provider (添加提供商) ,并从菜单中选择一个。

如果您添加的是 Google Vertex、OpenAI 或 AWS Bedrock 提供商,请参阅 具体配置说明以了解后续步骤。

点击 Save (保存)。

测试与 AI 提供商的连接

如果 AI 模型停止响应,请测试连接。 问题可能与身份验证有关,例如令牌已过期,或 AI 提供商端的配置更改。 连接测试失败会返回带有描述的错误,以帮助您识别并解决问题。

您还可以在添加 AI 提供商时检查连接,以确保您的配置正确,并且输入的 API 密钥或令牌有效。

测试连接:

设置默认的 AI 提供商

如果贵组织 已启用多个 AI 提供商 ,当您在配置文件中启用 AI Enterprise 时,您设置的默认提供商将被预选。 此外,它允许您为所有当前选中 Default (默认) 提供商选项的配置文件集中切换服务提供商。

您可以设置多个默认提供商,但如果选择了 JetBrains AI,则必须只设为唯一默认提供商。

选择默认提供商:

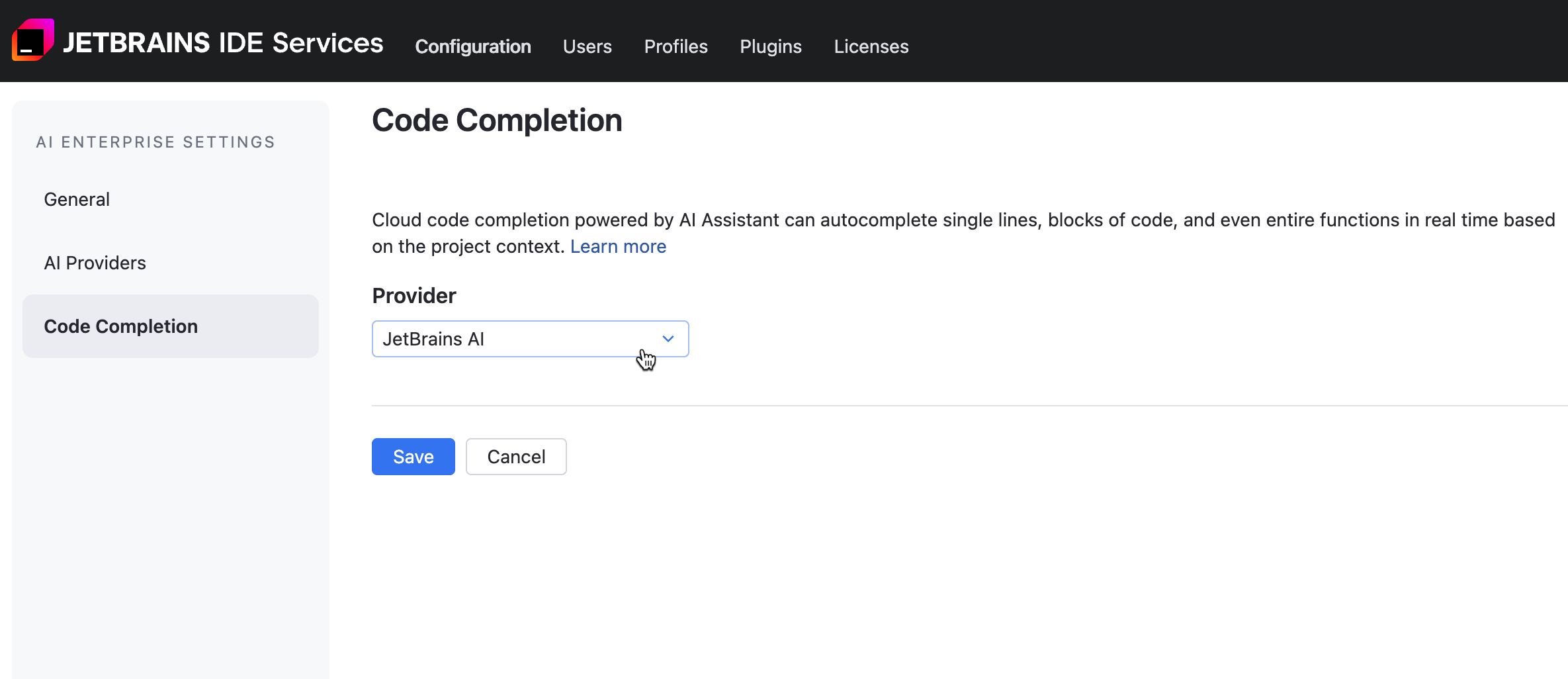

设置代码补全提供商

Mellum 引擎为 AI Enterprise 提供代码补全功能。 您可以配置使用自托管的 Mellum 实例、JetBrains 托管的 Mellum 服务(JetBrains AI),或让系统自动从可用选项中选择最合适的提供商。

设置代码补全提供商:

导航到 。

向下滚动到 AI Enterprise 部分,并点击 Settings (设置)。

打开 选项卡。

在 菜单中,选择以下选项之一:

:会自动从为特定用户可用的提供商中选择最合适的一个。 如果 JetBrains AI 可用,将优先使用。

:使用 JetBrains 托管的 Mellum。

:使用本地部署的 Mellum 引擎。

点击 Save (保存)。

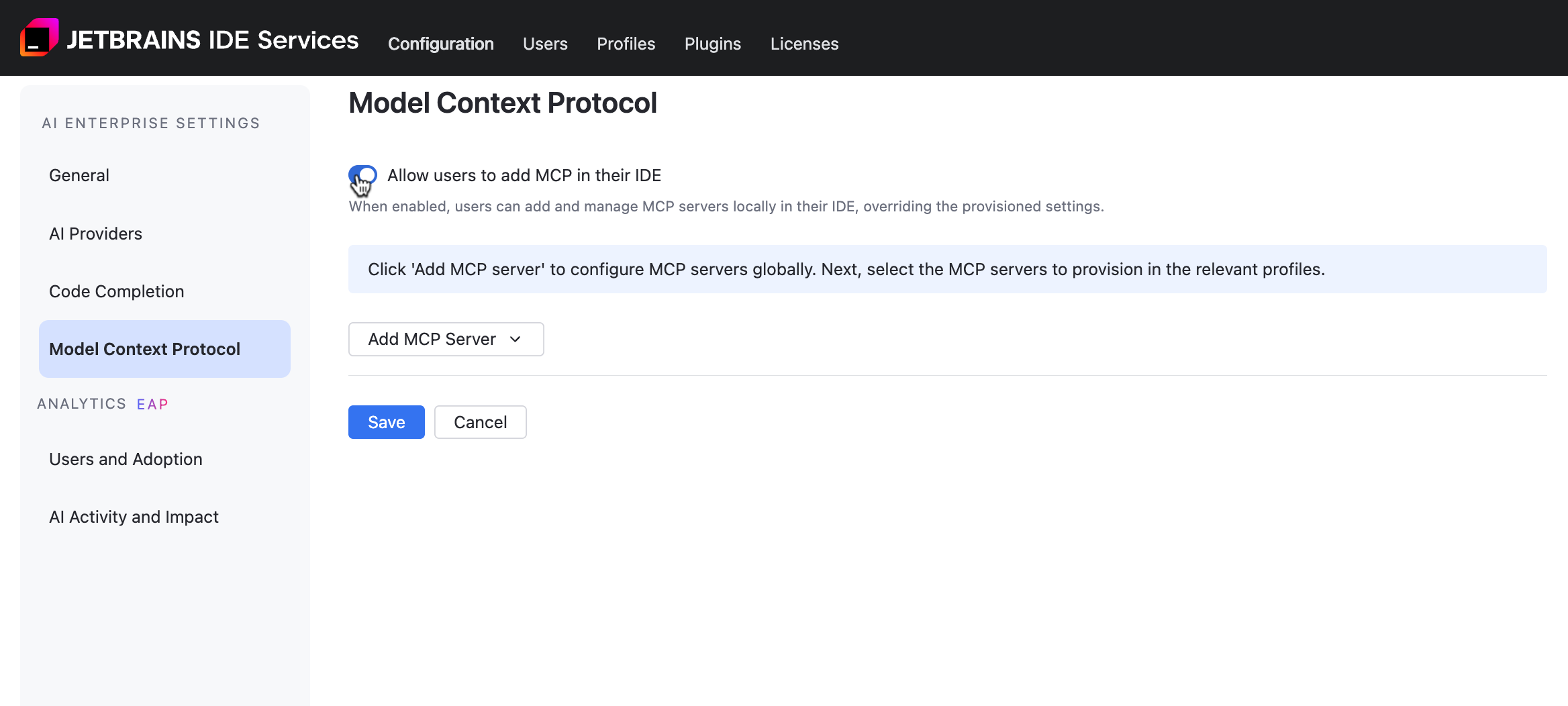

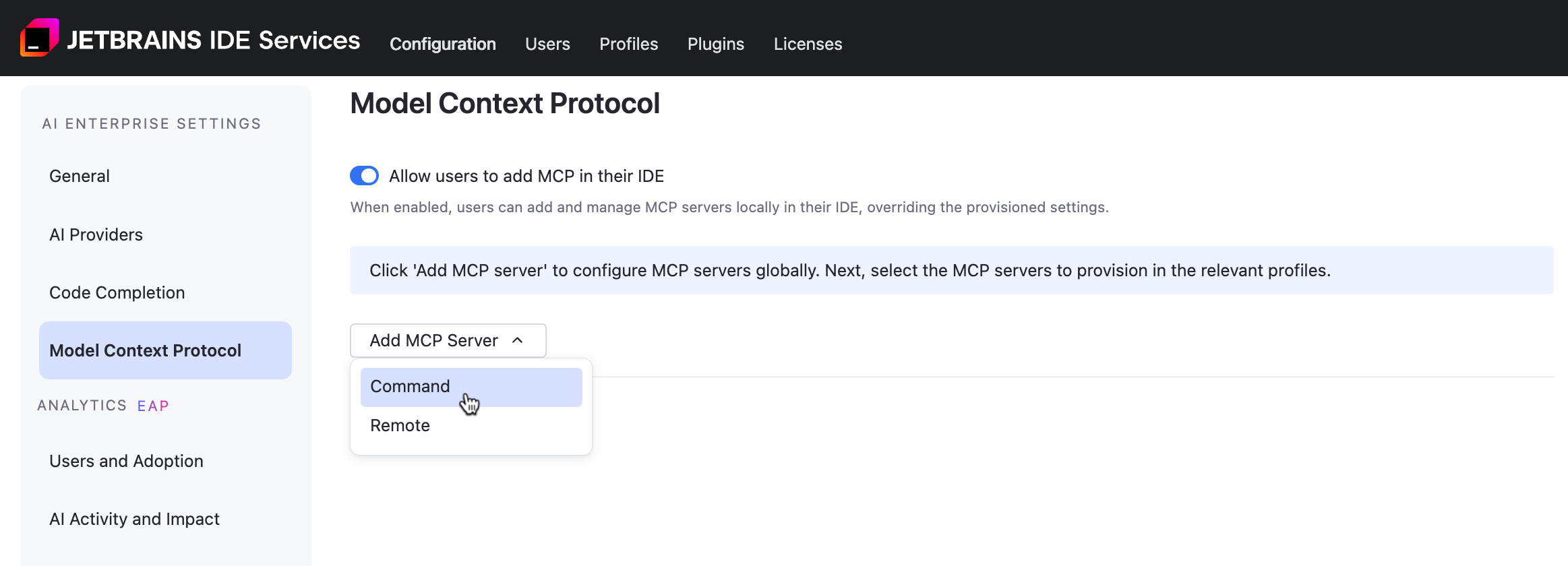

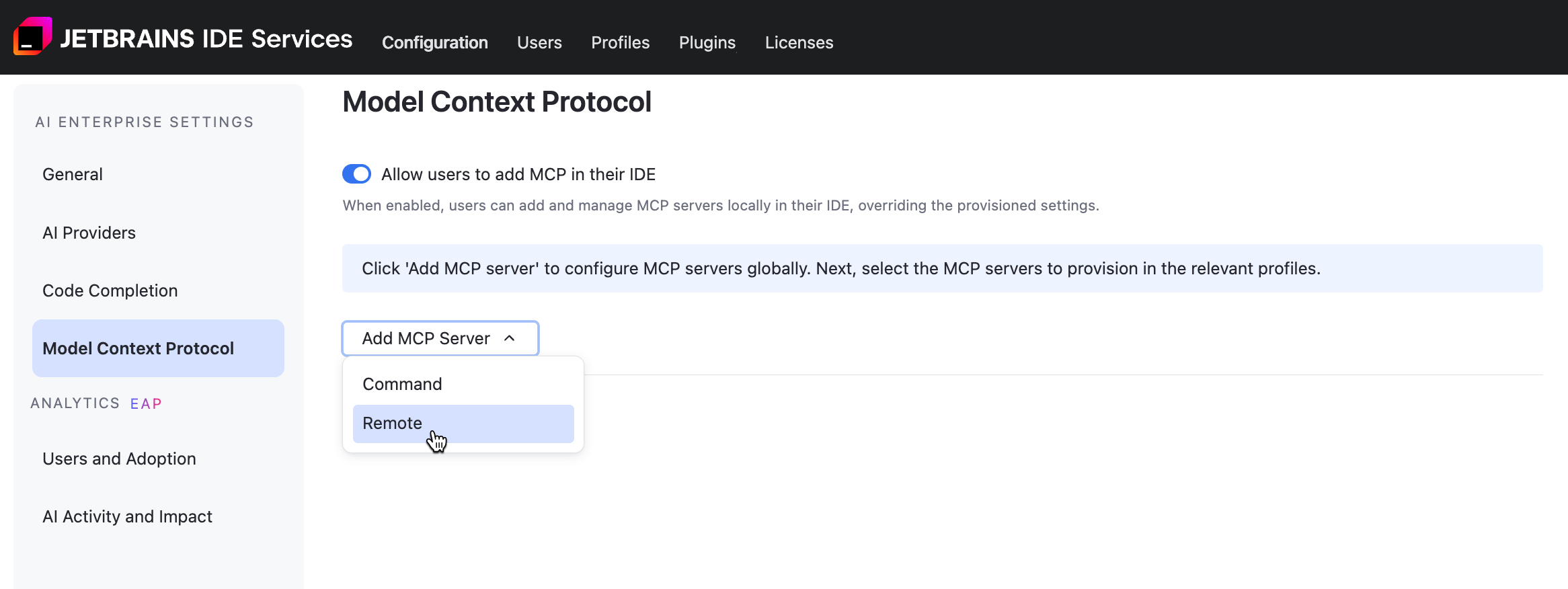

模型上下文协议设置

MCP(Model Context Protocol)是一种允许 LLM 与资源、系统或数据交互的方法。 您可以配置命令和远程 MCP 服务器,并定义是否允许开发人员添加其他服务器。

禁止用户在 IDE 中添加 MCP 服务器

添加命令 MCP 服务器

添加远程 MCP 服务器

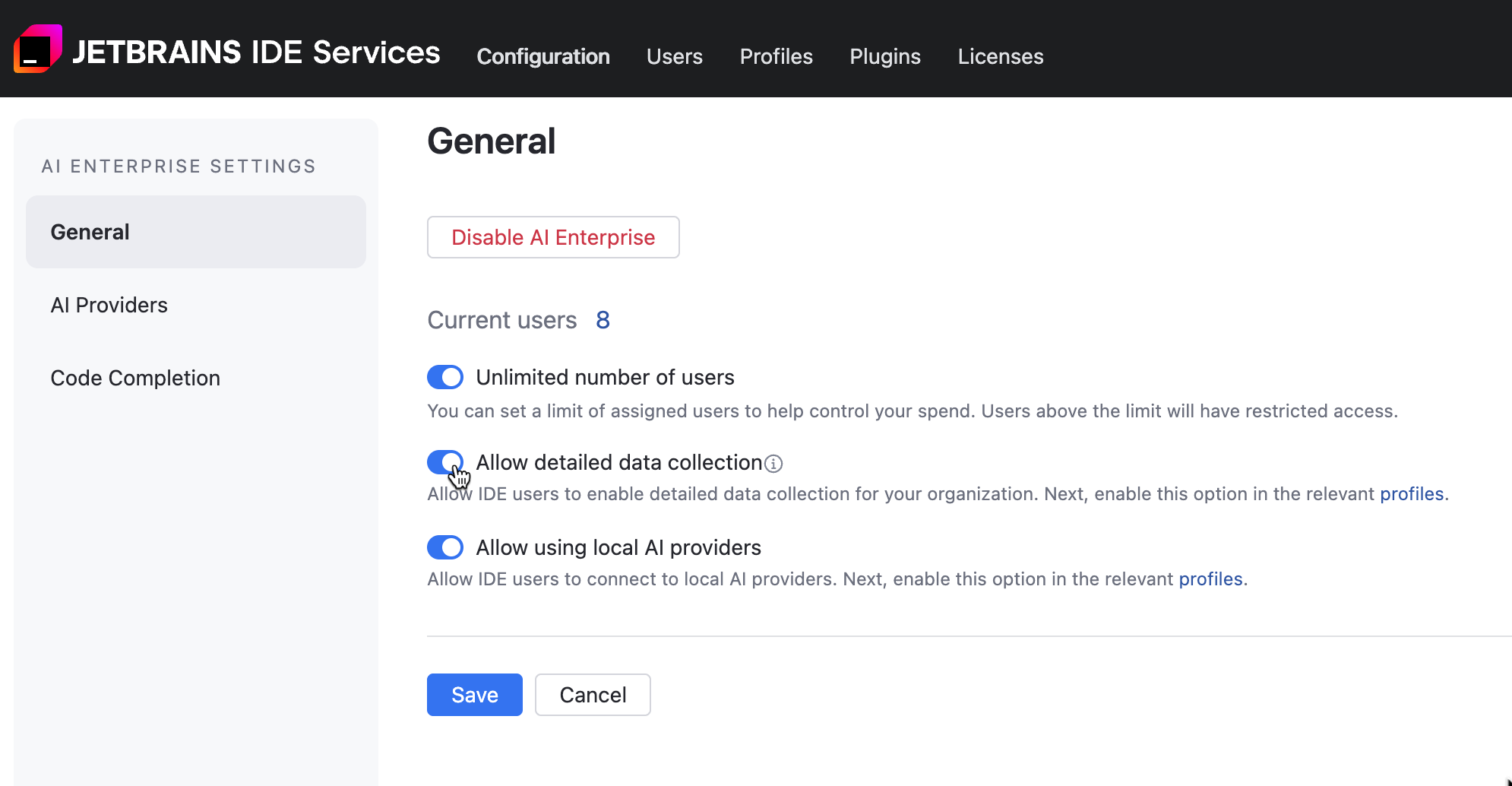

更新 AI Enterprise 使用限制

导航到 。

向下滚动到 AI Enterprise 部分,并点击 Settings (设置)。

在 AI Enterprise Settings (AI Enterprise 设置) 页面上,为 AI Enterprise 配置用量限制:

启用 Unlimited number of users (用户数量不受限制) 选项,使所有 在配置文件级别启用 AI Enterprise 的用户均可访问 AI 功能。

禁用 Unlimited number of users (用户数量不受限制) 选项,并指定 AI Enterprise 用户的数量上限。 超过此限制的用户 将被限制使用产品功能。

点击 Save (保存)。

允许详细的数据收集

导航到 。

向下滚动到 AI Enterprise 部分,并点击 Settings (设置)。

在 General (常规) 选项卡中,使用 Allow detailed data collection (允许详细的数据收集) 选项为您的组织启用或禁用 详细数据收集。 启用此选项后,用户将被要求授权数据共享。 收集 AI 交互数据有助于提升 LLM 性能。

点击 Save (保存)。

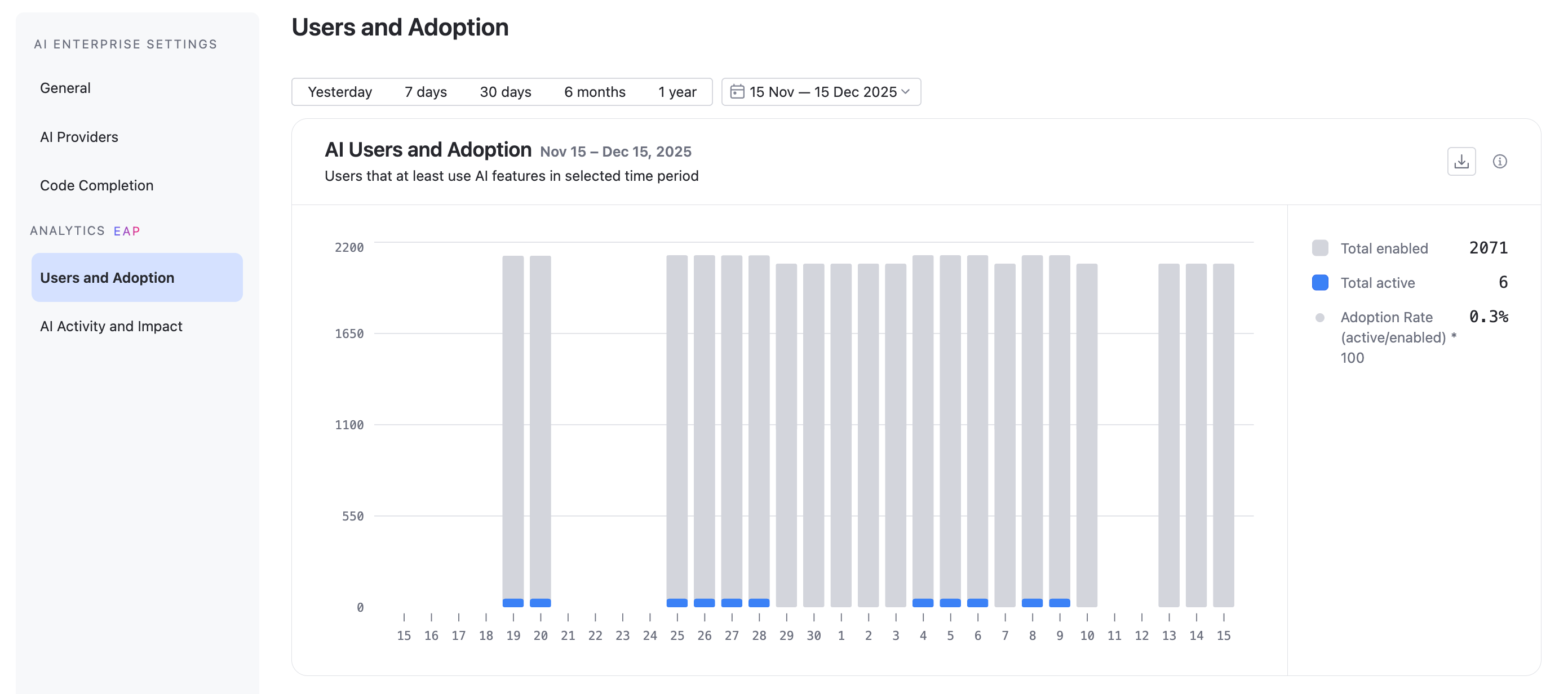

为您的组织获取分析数据

为您的组织禁用 AI Enterprise

为您的 IDE Services 添加更多 AI Enterprise 用户

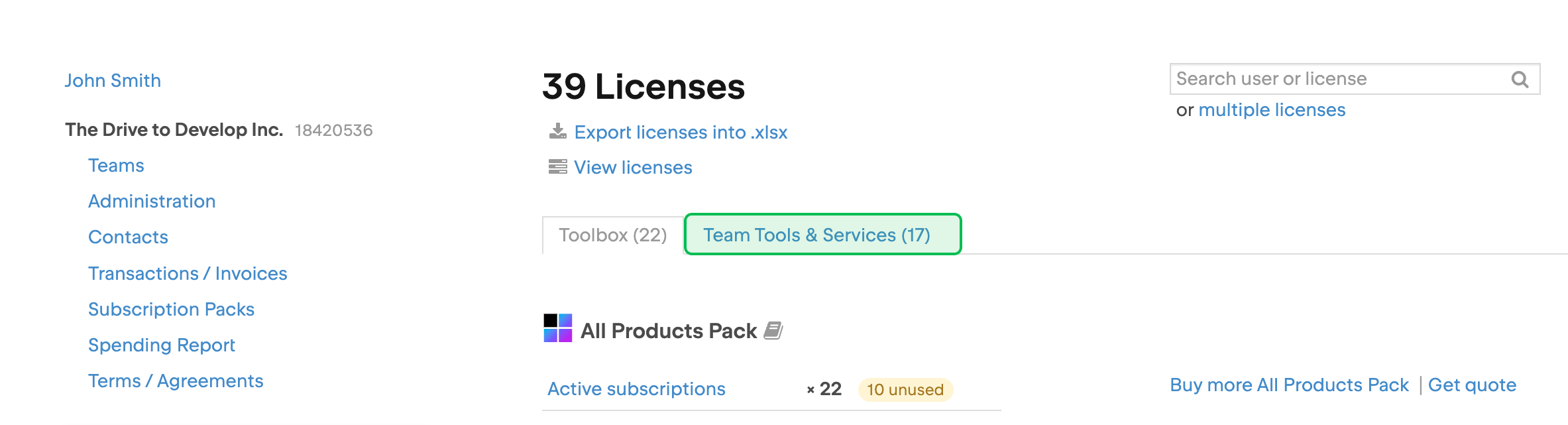

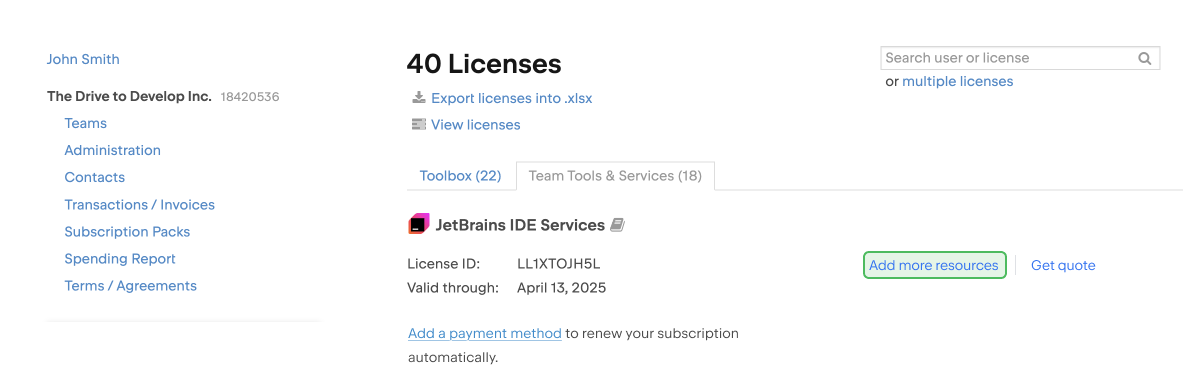

使用 预付费计费模式后,您可以在组织的 JetBrains 账户 购买更多 IDE 服务许可资源。

使用组织或团队管理员权限登录您的 JetBrains 账户。

在左侧菜单中,点击您的组织名称。

在页面顶部,点击 。

在许可证总览页中,选择 Team Tools & Services (团队工具与服务) 选项卡。

找到 IDE 服务许可并点击 Add more resources (添加更多资源)。 您可能需要向下滚动以找到该许可证。

将打开结算页面。 在那里,您可以选择要添加的资源并进行支付。